της Τζένης Τσιροπούλου

Βρισκόμαστε στο Λονδίνο το 1952 και ένα 5χρονο αγόρι με καταγάλανα μάτια επιστρέφει στο σπίτι με το λεωφορείο. Το παιδί παίζει με ένα νόμισμα. Το τοποθετεί στην άκρη του βελούδινου καθίσματος και προς μεγάλη του έκπληξη, το κέρμα δεν κυλάει όπως ορίζει ο νόμος της βαρύτητας. Το αγόρι είναι σίγουρο ότι αυτό που συμβαίνει είναι αδύνατον.

Οποιοσδήποτε άλλος θα είχε ξεχάσει αυτό το μυστήριο μέχρι το μεσημεριανό γεύμα.

Το αγόρι της ιστορίας μας όμως είναι ο Τζέφρι Χίντον – γνωστός διεθνώς ως “ο νονός της Τεχνητής Νοημοσύνης”.

Αυτό το αίνιγμα τον βασάνιζε για δέκα χρόνια και έπαιξε καθοριστικό ρόλο στο τι θα αναζητούσε να κατανοήσει για τον εγκέφαλο και τις λειτουργίες του για να φτάσει τελικά να δημιουργεί μηχανές με τεχνητούς εγκεφάλους, “καλύτερους κι από τους ανθρώπινους”.

Σήμερα, η Τεχνητή Νοημοσύνη φτάνει πιο κοντά από ποτέ στη ζωή μας και οι περισσότεροι την υποδεχόμαστε με δέος και καχυποψία.

Όχι περίεργο, αν σκεφτεί κανείς ότι ακόμα και ο ίδιος ο Χίντον νιώθει σήμερα δέος και καχυποψία απέναντι στο δημιούργημά του.

Ο Τζέφρι Χίντον.

Βρισκόμαστε εκ νέου στο Λονδίνο, 70 χρόνια μετά, και συγκεκριμένα στα Διεθνή Βραβεία Φωτογραφίας SONY 2023.

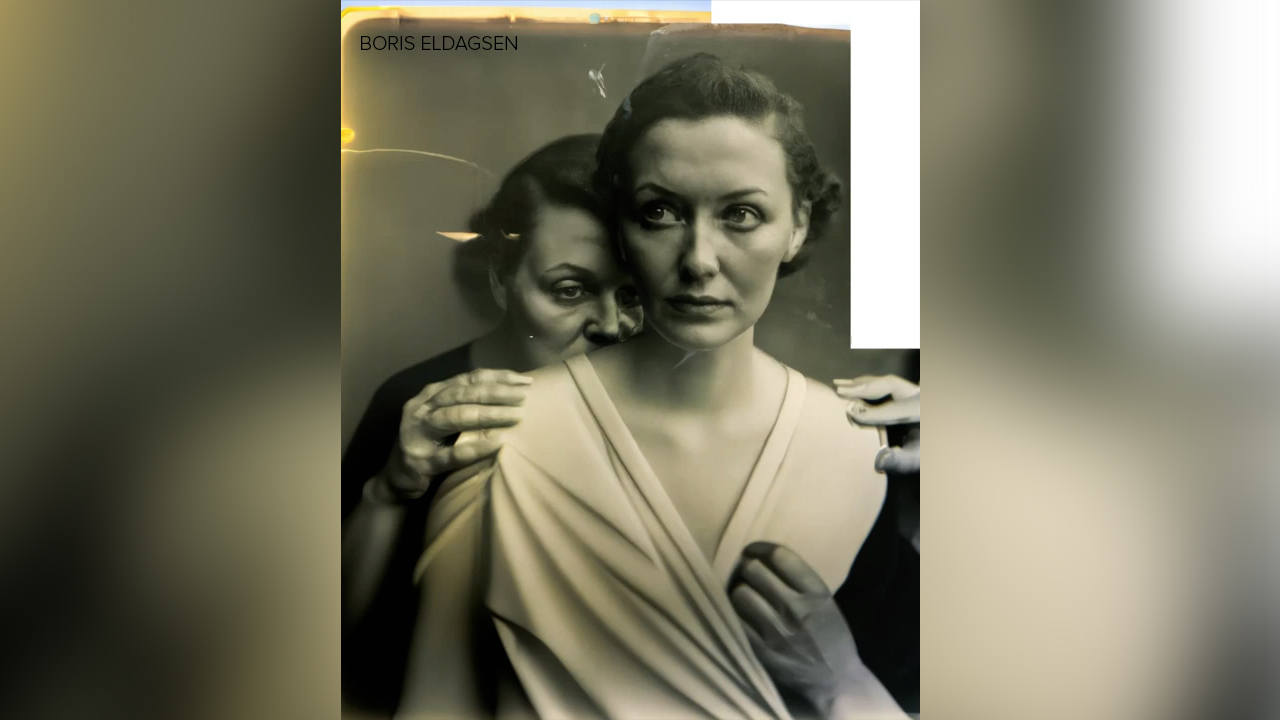

Ένας Γερμανός φωτογράφος, ο Μπόρις Έλνταγκσεν, πρόκειται σε λίγα λεπτά να λάβει ένα σημαντικό βραβείο αλλά η είδηση δεν θα είναι αυτή.

Φοράει ένα δανεικό μαύρο κοστούμι και έχει πληρώσει από την τσέπη του τα αεροπορικά και το ξενοδοχείο. Δεν δικαιούται χρόνο ομιλίας κατά την απονομή αλλά θέλει πάση θυσία να πάρει τον λόγο.

Ο Έλνταγκσεν βραβεύτηκε στην κατηγορία ‘Δημιουργική Φωτογραφία’ για μία υποτιθέμενα χειροποίητη δημιουργία του ενώ εκείνος είχε εσκεμμένα καταθέσει μία φωτογραφία φτιαγμένη εξ ολοκλήρου με ΑΙ.

“Έχουμε ήδη αργήσει! Δεν έχουμε τη γνώση και τα αντανακλαστικά. Δεν είμαστε έτοιμοι για όλο αυτό που συμβαίνει με την ΑΙ. Πρέπει να ανοίξει επειγόντως δημόσια η συζήτηση” ήταν το μήνυμα που ήθελε να περάσει ο φωτογράφος.

“Με νοιάζει ότι οι φωτογράφοι δεν θα μπορούν να πληρώνουν πια ούτε το ενοίκιό τους γιατί πολλά επαγγέλματα χάνονται λόγω της ΑΙ. Βλέπω όμως και τα προβλήματα για τις Δημοκρατίες – τον καταιγισμό ψεύτικων εικόνων και τους πολίτες που δεν θα μπορούν να διακρίνουν το αληθινό από το ψεύτικο”.

Ο Έλνταγκσεν αρνήθηκε το βραβείο και δημιούργησε θόρυβο στα διεθνή ΜΜΕ.

Η φωτογραφία που κατέθεσε ο Έλνταγκσεν στον διαγωνισμό.

Θέσεις εργασίας vs AI: Κι άλλη φτωχοποίηση ή οι σχέσεις εξουσίας με άλλο μάτι;

Ένα φλέγον ζήτημα είναι πράγματι τα επαγγέλματα που θα επηρεαστούν εξαιτίας της ΑΙ.

“Η ΑΙ σίγουρα θα αλλάξει το τοπίο στη φωτογραφία και πιθανόν θα αντικαταστήσει πλήρως τον φωτογράφο – όχι στο φωτορεπορτάζ που είναι συνδεδεμένο με το ντοκουμέντο αλλά σίγουρα σε άλλα πεδία της φωτογραφίας” λέει στο TPP η ιστορικός Τέχνης, Πηνελόπη Πετσίνη.

“Αυτό είναι ένα μεγάλο ζήτημα και για εμάς που εργαζόμαστε στην εκπαίδευση γιατί δεν μπορούμε καν να φανταστούμε αυτή τη στιγμή ποιες δεξιότητες θα χρειάζονται οι νέοι επαγγελματίες κοιτώντας το μέλλον. Και στην Ελλάδα δυστυχώς το εκπαιδευτικό σύστημα δεν προσαρμόζεται γρήγορα στις αλλαγές” προβληματίζεται η Πετσίνη που διδάσκει στο Τμήμα Φωτογραφίας στο Πανεπιστήμιο Δυτικής Αττικής.

“Θα χαθούν κάποια επαγγέλματα ανεπιστρεπτί αλλά θα δημιουργηθούν και καινούρια. Διάβαζα το ποστ ενός σκηνοθέτη που εξηγούσε πώς έφτιαξε σχεδόν δωρεάν σκηνικά για διαφήμιση που κανονικά θα κόστιζαν εκατομμύρια ευρώ.”

Η καθηγήτρια αναφέρεται στον Νίκο Σταμπουλόπουλο που πειραματίζεται με διαφημιστικά σποτ φτιαγμένα με τεχνητή νοημοσύνη.

“Μου πήρε μόλις δύο μέρες για να σκαρώσω ένα show reel διαφημιστικών πλάνων που δημιουργήθηκαν αποκλειστικά με προγράμματα ΑΙ. Η ποιότητα της εικόνας απέχει από τις επαγγελματικές προδιαγραφές αλλά είναι ζήτημα μηνών, αν όχι εβδομάδων, το να έχουμε στη διάθεση μας εργαλεία τεχνητής νοημοσύνης που θα μπορούν να φτιάξουν πλάνα υψηλής ποιότητας και αισθητικής τα οποία θα φαίνονται αληθινά” έγραψε στο Facebook ο σκηνοθέτης.

“Κι αυτό από τη μία σημαίνει δραματική μείωση του κόστους των διαφημιστικών σποτ – όπου πλέον ένας μικρός πελάτης θα μπορεί να έχει το ίδιο production value με την πανάκριβη καμπάνια μιας πολυεθνικής – και από την άλλη ότι πολλοί επαγγελματίες του χώρου θα χάσουν τις δουλειές τους.”

ΑΙ generated φωτογραφία του Νίκου Σταμπουλόπουλου.

“Μόνο για ένα πλάνο, όπως αυτό με το σιρόπι σοκολάτας που πέφτει στο παγωτό, έως τώρα χρειαζόταν να νοικιαστεί στούντιο και εξοπλισμός, να δουλέψουν τουλάχιστον 5-6 άνθρωποι και να το επεξεργαστούν μετά άλλοι τόσοι. Για μοντέλα που χαμογελούν […] δεν το συζητάμε, ενώ το να κλείσεις τη Metropolitan Opera της Νέας Υόρκης για γύρισμα είναι απαγορευτικό. Τώρα, μπορεί κανείς να τα φτιάξει όλα αυτά μόνος του μέσα σε μία ώρα” προϊδεάζει το ποστ του σκηνοθέτη.

Το πειραματικό διαφημιστικό του Νίκου Σταμπουλόπουλου.

Λίγες μέρες μετά το “σκάνδαλο” με τον Γερμανό φωτογράφο και τα Βραβεία, μία άλλη κίνηση-ματ ξανάφερε στα πρωτοσέλιδα την ΑΙ.

Παραιτήθηκε από την Google ο Τζέφρι Χίντον, ο νονός της ΑΙ, που για μία δεκαετία ανέπτυσσε στον τεχνολογικό κολοσσό προγράμματα τεχνητής νοημοσύνης.

Ο λόγος, σύμφωνα με τον ίδιο, ήταν “για να μπορέσει να μιλήσει ελεύθερα για τους κινδύνους της”.

Το θέμα της μαζικής απώλειας θέσεων εργασίας είναι από αυτά που τρομοκρατούν τον Χίντον.

Σε δημόσια διάλεξη στο London School of Economics, τον Μάρτιο του 2024, ο 76χρονος επιστήμονας είπε:

“Αυτό που έκανε η βιομηχανική επανάσταση στους εργάτες, τώρα θα το κάνει η τεχνητή νοημοσύνη στα πνευματικά επαγγέλματα. […] Η ΑΙ θα μεγαλώσει το χάσμα μεταξύ πλουσίων και φτωχών: από τη μία θα είναι αυτοί που την κατέχουν, όπως ο Έλον Μασκ, που θα γίνονται πλουσιότεροι και από την άλλη θα είναι αυτοί που χάνουν μαζικά τις δουλειές τους και γίνονται φτωχότεροι. […] Και βλέπουμε ήδη γύρω μας την άνοδο του φασισμού εξαιτίας της οικονομικής εξαθλίωσης. […] Όλο αυτό με τρομοκρατεί.”

Η συνομιλίτριά του, Dr Kate Vredenburgh, καθηγήτρια Φιλοσοφίας, παραδέχτηκε και εκείνη ότι, νιώθει “νευρικότητα απέναντι στο τι θα συμβεί” αλλά υποστήριξε τη λιγότερο δημοφιλή άποψη ότι η ΑΙ μπορεί να κάνει υπερκοστολογημένες υπηρεσίες προσβάσιμες και να αναδιαμορφώσει τις σχέσεις εξουσίας:

“Ίσως να μην είναι όλα αρνητικά. Ζούμε σε πολύ άνισες κοινωνίες όπου οι ελίτ ασκούν εξουσία αλλά τώρα είναι ακριβώς αυτές οι ελίτ που φοβούνται γιατί η ΑΙ θα κάνει τη δουλειά τους καλύτερα από αυτούς: είμαστε εμείς οι ακαδημαϊκοί, οι μάνατζερ, οι δημοσιογράφοι, κλπ. Είναι μια καλή στιγμή για να επανεξετάσουμε τις ανισότητες”.

Deep Fakes: Robocalls, προσευχές και η μισή υφήλιος στις κάλπες

Στη λίστα με τους κινδύνους της ΑΙ πολύ ψηλά βρίσκεται και το θέμα των deep fakes – η ψηφιακή παραποίηση δηλαδή μιας φωτογραφίας ή ενός βίντεο έτσι ώστε τα χαρακτηριστικά ενός ατόμου να αλλοιώνονται – από το να φαίνεται γυμνός ενώ δεν ήταν, να βρίσκεται σε έναν τόπο που δεν μετέβη ποτέ, κλπ.

Μπορεί η παραποίηση φωτογραφιών να μην είναι φρέσκια τέχνη αλλά οι δυνατότητες – ποιοτικές και ποσοτικές – των νέων τεχνολογικών εργαλείων έχουν λόγο να μας προβληματίζουν.

Ιδιαίτερη ανησυχία δημιούργησαν τα deep fake ενόψει εκλογών αφού το 2024 για πρώτη φορά στην Ιστορία θα βρεθεί στις κάλπες το 49% του παγκόσμιου πληθυσμού – μεταξύ τους και η ΕΕ.

Τον Ιανουάριο του 2024, 5.000 ψηφοφόροι στο New Hampshire έλαβαν μία κλήση στο τηλέφωνό τους όπου ο πρόεδρος Μπάιντεν – ή πιο σωστά, μία φωνή φτιαγμένη με ΑΙ που μιμούνταν τον Μπάιντεν (robocall) – προέτρεπε τους ψηφοφόρους να μην πάνε να ψηφίσουν στις προκριματικές εκλογές.

Ο άνθρωπος που ομολόγησε ως αυτουργός, είχε λάβει 250.000 δολάρια προκειμένου να προωθήσει βασικό αντίπαλο του Μπάιντεν για την κούρσα των Δημοκρατικών.

Το συμβάν καταγράφηκε ως η πρώτη μεγάλη απόπειρα εκλογικής εξαπάτησης με ΑΙ.

Νομοθέτες και πολιτικοί θορυβήθηκαν για το πώς θα οριοθετηθούν τα παραγόμενα με ΑΙ χωρίς να προσβάλουν την ελευθερία του λόγου.

Τελικά, σε χρόνο ντετέ, τα robocalls θεσμοθετήθηκαν ως παράνομα.

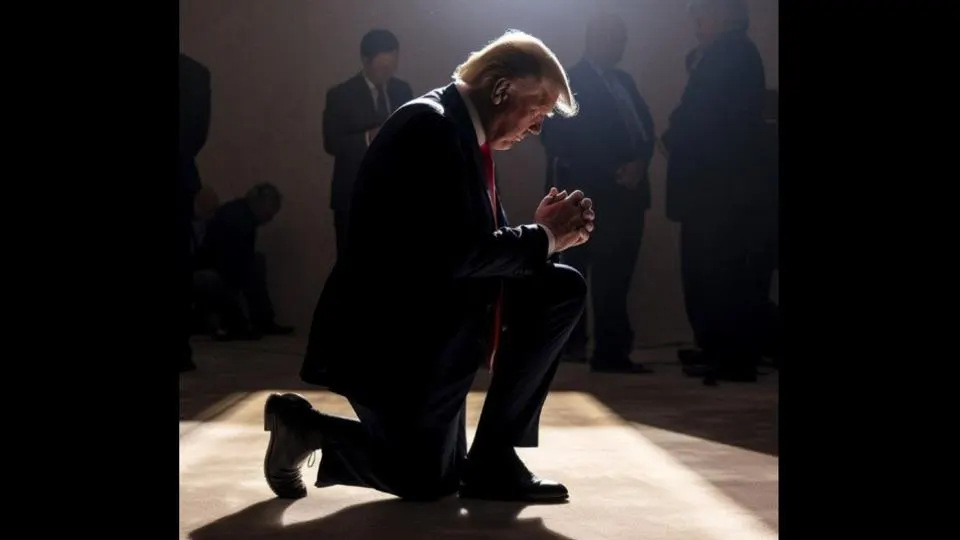

ΑΙ generated φωτογραφία με τον Ντ.Τραμπ

Τον Μάρτιο, ο Τραμπ πόσταρε – προφανώς εν γνώσει του – μία fake φωτογραφία του εαυτού του να γονατίζει και να προσεύχεται στον Ιησού Χριστό με κατάνυξη.

To κόμμα των Ρεπουμπλικανών έφτιαξε ένα δραματικό βίντεο που προσιδιάζει σε τρέιλερ ειδήσεων και παρουσιάζει τις καταστροφές που έχουν συμβεί ήδη σε ένα σενάριο επανεκλογής του Μπάιντεν. Αυτό μπορεί να μην είναι ψευδής είδηση αλλά και εδώ υπάρχει ένα πρόβλημα.

Tο πρόβλημα είναι ότι σε κανένα από τα παραπάνω παραδείγματα, και σε αμέτρητα ακόμα τέτοια προϊόντα ΑΙ, δεν αναφέρεται ότι “αυτό που βλέπετε είναι προϊόν ΑΙ”.

Και είναι γεγονός ότι ιδιαιτέρως το βίντεο μοιάζει πολύ πειστικό στον θεατή, συνειδητά ή υποσυνείδητα.

“Ο οπτικός αναλφαβητισμός είναι ήδη μεγάλο πρόβλημα. Οι περισσότεροι άνθρωποι παίρνουν την εικόνα κυριολεκτικά, δεν ξέρουν να αναγνωρίσουν τους μηχανισμούς κατασκευής της. Από την εφεύρεση της φωτογραφίας μέχρι και σήμερα, η πλειοψηφία τείνει να ταυτίζει το φωτογραφημένο πράγμα με το πραγματικό, ότι “έτσι είναι”. Η ΑΙ χειροτερεύει αυτή τη συνθήκη. Από την άλλη, το ότι ένα μεγάλο μέρος του κόσμου θα αμφισβητεί τα πάντα ως μη πραγματικά, είναι και αυτό προβληματικό για τον άνθρωπο και τη Δημοκρατία” λέει η ιστορικός Φωτογραφίας, Πηνελόπη Πετσίνη.

Προβληματισμός υπάρχει και στο πεδίο της πολιτικής επικοινωνίας:

“Το ίντερνετ γεμίζει συνεχώς με deep fake. Αυτό προκαλεί μεγαλύτερη καχυποψία και σύγχυση στον ψηφοφόρο χειροτερεύοντας μία ήδη κακή σχέση με τα μίντια και τους θεσμούς. Αλλά δεν θα χαθούν εκλογές γι’ αυτόν τον λόγο. Οι δημοκρατικές δυνάμεις θα χάσουν γιατί υιοθετούν όλο και πιο δεξιά ατζέντα” λέει στο TPP ο Arun Chaudhary, επικοινωνιολόγος που υπήρξε το δεξί χέρι του Ομπάμα.

Ο Chaudary αυτή την περίοδο μελετάει το πώς πολιτικοί σε όλο τον κόσμο χρησιμοποιούν την ΑΙ στις καμπάνιες τους και προσπαθεί να εμπλουτίσει και ο ίδιος τις γνώσεις του.

“Με πονάει που η Δεξιά είναι πάντα πιο πρόθυμη να πειραματιστεί με τις νέες τεχνολογίες” λέει στο TPP ενώ δείχνει την ιστοσελίδα ενός ακροδεξιού υποψηφίου στην Ινδονησία που έχει κάνει “μακράν την πιο έξυπνη χρήση ΑΙ” προμοτάροντας την ενεργή εμπλοκή του ψηφοφόρου με τεχνικές storytelling και video games.

“Μιλάμε μόνο για τις βλαπτικές συνέπειες, αλλά η τεχνητή νοημοσύνη φέρνει ένα σημαντικό πλεονέκτημα στην πολιτική επικοινωνία: Πολιτικοί και μικρά κόμματα με περιορισμένους πόρους θα μπορούν να δημιουργούν περιεχόμενο μέσω της ΑΙ και να φτάσουν στον κόσμο οι θέσεις τους” τονίζει ο επικοινωνιολόγος.

“Η ΑΙ θα μειώσει τις οικονομικές ανισότητες στις πολιτικές καμπάνιες” και εμείς “θα πρέπει να μάθουμε να ζούμε μ’ αυτήν και να εκπαιδευτούμε να ξεχωρίζουμε το τι είναι αληθινό και τι όχι”.

Deepfake με τον Ομπάμα.

ΕΕ: Η πρώτη νομοθεσία στον κόσμο για την ΑΙ και τα μελανά της σημεία

Η Λαμπρινή Γυφτοκώστα είναι δικηγόρος και Διευθύντρια Τεχνητής Νοημοσύνης και Ανθρωπίνων Δικαιωμάτων της ΜΚΟ Homo Digitalis.

Εδώ και μήνες ξενυχτάει πάνω από ένα αχανές και δύστροπο κείμενο: τη νομοθεσία της Ευρωπαϊκής Ένωσης για την ΑΙ.

Στις 13 Μαρτίου 2024 η Ευρωπαϊκή Ένωση ψήφισε το EU AI Act, την πρώτη νομοθεσία στον κόσμο για τη ρύθμιση του πεδίου της Τεχνητής Νοημοσύνης, η οποία σταδιακά θα ενσωματωθεί στο εθνικό μας δίκαιο.

“Ο βασικός λόγος είναι για να υπάρχουν ομοιογενείς κανόνες στην αγορά της ΕΕ για τις εταιρείες που παράγουν ή εισάγουν εργαλεία τεχνητής νοημοσύνης. Και μετά ακολουθούν τα ανθρώπινα δικαιώματα” λέει η Γυφτοκώστα.

“Το Act ορίζει τα όρια μέσα στα οποία μπορούν να κινηθούν οι εταιρείες. Θέτει τρεις κατηγορίες: τα απότοκα της ΑΙ που είναι απολύτως απαγορευμένα στη ΕΕ γιατί θεωρούνται πολύ επικίνδυνα, όπως το social scoring (που επιτρέπεται στην Κίνα). Απαγορεύει, δηλαδή, κάθε σύστημα ΑΙ που αξιολογεί και κατηγοριοποιεί τους ανθρώπους βάσει του αν πλήρωσαν την εφορία, αν χρησιμοποιούν social media, κλπ. Άλλες χρήσεις ΑΙ θεωρούνται μεσαίου ρίσκου και επιτρέπονται υπό προϋποθέσεις και τέλος, είναι οι χρήσεις χαμηλού ρίσκου που τις θεωρεί σχεδόν ακίνδυνες.”

Ο Τζέφρι Χίντον στη διάλεξή του έκανε ένα αιχμηρό σχόλιο για τα νομικά πλαίσια που φτιάχνονται για την ΑΙ:

“Στις κυβερνήσεις αρέσει να μας ελέγχουν αλλά δεν τους αρέσει να ελέγχουν τον εαυτό τους. Σε όλες τις νομοθεσίες για την ΑΙ, υπάρχει πάντα ένας αστερίσκος που λέει ότι εξαιρούνται οι στρατιωτικές επιχειρήσεις”.

Ρωτάω την Γυφτοκώστα αν υπάρχουν προβληματικά σημεία στο Act και δη που να επιβεβαιώνουν τη δήλωση του Χίντον.

“Ναι, έτσι ακριβώς είναι. Οτιδήποτε αφορά τον στρατό και την εθνική ασφάλεια εξαιρείται από τους περιορισμούς της AI Act. Και αυτό εγείρει ζητήματα. Απαγορεύεται, για παράδειγμα, η λήψη βιομετρικών δεδομένων σε πραγματικό χρόνο εκτός αν εγείρεται θέμα εθνικής ασφάλειας, πχ. ψάχνουμε έναν ύποπτο τρομοκρατικής ενέργειας.”

Θα μπορεί δηλαδή να κυκλοφορεί ένα βανάκι της αστυνομίας και να παίρνει σε real time βιομετρικά στοιχεία στον δρόμο γιατί αναζητά κάποιον ύποπτο για συγκεκριμένα εγκλήματα;

“Ναι, θα μπορεί. Αλλά με δικλείδες ασφαλείας για όσους δεν θεωρούνται ύποπτοι. Είναι πολύ προβληματικά αυτά τα σημεία του Act για το πώς θα εφαρμοστούν. Επίσης, πρέπει να γνωρίζουμε ότι η Ελλάδα χρησιμοποιεί ήδη πιλοτικά συστήματα ΑΙ για βιομετρικά δεδομένα στα σύνορα για τους μετανάστες.”

Καμπάνια της Dove, με χρήση ΑΙ, για τις τοξικές συμβουλές ομορφιάς.

Deep fakes για bullying σε Δημοτικά σχολεία

Τα deep fakes προβλέπονται στο Act; ρωτάω τη Γυφτοκώστα.

“Τα deep fakes είναι ένα πολύ μεγάλο ζήτημα ενόψει των Ευρωεκλογών αλλά και όχι μόνο. Εμείς επισκεπτόμαστε σχολεία και κάνουμε μάθημα διαδικτυακού εκφοβισμού. Είδα τα deep fakes να χρησιμοποιούνται από μαθητές δημοτικού για να δημιουργήσουν πλαστό περιεχόμενο και να εκβιάσουν συμμαθητές τους. Παίρνουν φωτογραφίες τους, τις απογυμνώνουν και τους απειλούν ζητώντας λεφτά ή τα παπούτσια τους” λέει η δικηγόρος.

“Το EU Act αξιολογεί τα deep fake ως Low Risk. Δεν ισχύουν αυξημένα μέτρα. Το πρόβλημα είναι ότι ορίζει ότι πρέπει να υπάρχει διαφάνεια και να αναγράφεται πάντα ότι πρόκειται για κείμενο ή οπτικο/ακουστικό έργο που έχει παραχθεί ή παραποιηθεί με AI, αλλά δεν σου λέει πώς θα το κάνεις αυτό. Σου λέει απλώς να το κάνεις. Ποιος όμως θα το ρυθμίσει και θα το ελέγξει αυτό; Υποτίθεται ότι μελλοντικά θα καλυφθεί αυτό το κενό. Σε κάθε περίπτωση αν είσαι κακόβουλος, έχεις κυρώσεις. Ευθύνη φέρουν και πλατφόρμες, όπως το Facebook, X, Tik Tok, ως ενδιάμεσοι. Υποχρεούνται να ελέγχουν το περιεχόμενο των χρηστών και να το κατεβάζουν αν εντοπίσουν ότι είναι AI generated ή manipulated χωρίς αυτό να αναγράφεται. Αλλά η εταιρεία οφείλει να δώσει εξηγήσεις στον χρήστη αλλιώς θα τεθεί ζήτημα λογοκρισίας.”

Το πιο σημαντικό αντίβαρο: “Θα σώζει ανθρώπινες ζωές”

Η συζήτηση για την τεχνητή νοημοσύνη είναι γεμάτη από “ναι μεν, αλλά”.

Στην ομιλία του Χίντον, κάτω από τα bullet points με τους κινδύνους της ΑΙ, υπάρχει μία πρόταση με έντονα πορτοκαλί γράμματα:

“Mην ξεχνάμε ότι η ΑΙ θα είναι τρομερά σημαντική σε τομείς όπως η υγεία και η ιατρική και γι’ αυτό δεν πρέπει να σταματήσουμε την εξέλιξή της”.

Στην Αμερική 250.000 άνθρωποι πεθαίνουν κάθε χρόνο από λάθος διάγνωση. Η λάθος ιατρική διάγνωση αποτελεί την τρίτη αιτία θανάτου ακολουθώντας τις καρδιοπάθειες και τον καρκίνο.

“Αν δώσεις σε έναν γιατρό δύσκολες ιατρικές υποθέσεις, θα διαγνώσει σωστά το 40%. Αν δώσεις σε ένα σύστημα ΑΙ δύσκολες ιατρικές υποθέσεις, θα διαγνώσει σωστά το 50%. Γιατρός και ΑΙ μαζί θα φτάσουν το 60%” διευκρίνισε ο Χίντον.

Η ΑΙ θα πετυχαίνει πάντα καλύτερα αποτελέσματα αλλά το κρίσιμο είναι η συνέργεια ανθρώπου και μηχανής για να σώζονται ανθρώπινες ζωές.

Ο Χάρης Γεωργίου είναι ερευνητής πληροφορικής με διδακτορικό στην ιατρική διάγνωση και τις μαστογραφίες.

Εξηγεί στο TPP πώς σήμερα μπορούμε να πετύχουμε σωτήρια αποτελέσματα:

“Σήμερα, για ένα πρόβλημα ιατρικής διάγνωσης, ταΐζεις τον υπολογιστή με παραδείγματα και ανακαλύπτει μόνος του τι πρέπει να προσέχει για να κάνει διάγνωση. Δεν του υποδεικνύεις εσύ τι να εντοπίσει, π.χ. ‘Βρες μία μάζα με το τάδε σχήμα στη μαστογραφία’, αλλά του δίνεις εικόνες και μόνος του καταλαβαίνει αυτό που μαθαίνει ο γιατρός σε 12 χρόνια ιατρικής.”

Ο Γεωργίου είναι επίσης μέλος της Ελληνικής Ομάδας Διάσωσης η οποία έχει επιχειρήσει στο πολύνεκρο δυστύχημα στα Τέμπη, στο Μάτι, σε ναυάγια μεταναστών και στον καταστροφικό σεισμό στην Τουρκία.

Γνωρίζει καλά τις τεχνολογίες που σχεδιάζονται αυτή τη στιγμή για τη διάσωση ανθρώπων που βρίσκονται, για παράδειγμα, εγκλωβισμένοι μετά από σεισμό:

“Αυτό που σχεδιάζεται αυτή τη στιγμή με ΑΙ για τη διάσωση ανθρώπων είναι ο εντοπισμός θυμάτων στα ερείπια. Αυτό δεν είναι καθόλου εύκολο. Πρέπει να συνδυάσεις πληροφορίες από το γάβγισμα του σκύλου, ανίχνευση χημικών ουσιών με αισθητήρες που κάνουν ανάλυση χημικού σήματος, κ.ά. Αυτό γίνεται μέσω μηχανικής μάθησης. Δηλαδή παίρνεις το σήμα, κάνεις μία ανάλυση μέσω νευρωνικών δικτύων και το νευρωνικό δίκτυο σου λέει ότι ‘αυτό που μυρίζω έχει αυτό το pattern, υπολογίζω ότι πρόκειται για ζωντανό άνθρωπο και αυτό που μυρίζω είναι ιδρώτας. Ή μπορεί να μυρίσει πτωμαΐνη και να σου πει ότι επειδή φυσάει προς αυτή την κατεύθυνση ο αέρας, εσείς ψάξτε προς τη δείνα κατεύθυνση.”

“Στην τεχνητή νοημοσύνη δουλεύεις πολλά χρόνια πάνω σε κάτι που θα το βελτιώσεις κατά μόλις 2 ή 3%. Αλλά αυτό το 2-3% έχει πολύ σημαντικό αντίκτυπο. Αν μιλάμε για τον εντοπισμό ναυαγών νύχτα σε φουρτουνιασμένη θάλασσα με καταιγίδα, αυτό το 2% ισοδυναμεί με 8 λεπτά έρευνας του ελικοπτέρου και αυτό μπορεί να σημαίνει ότι έσωσες 300 ανθρώπους παραπάνω σε έναν χρόνο.”

Λίγη ώρα μετά τη συνέντευξη, ο Γεωργίου μού στέλνει ένα άρθρο, με τη σημείωση: “Ένα παράδειγμα για αυτή τη σταδιακή, αόρατη βελτίωση μέσω ΑΙ που περνά απαρατήρητη”.

Το άρθρο μιλάει για 11 γυναίκες που σώθηκαν χάρη στην ΑΙ καθώς το πρόγραμμα τεχνητής νοημοσύνης, Mia, που εφαρμόζεται πιλοτικά στο αγγλικό σύστημα υγείας NHS, εντόπισε πολύ μικρά σημάδια πρώιμου καρκίνου του μαστού εκεί που οι γιατροί δεν είχαν καταφέρει να τα διαγνώσουν.

Μετά τη διάγνωση, όμως, ανέλαβε αμέσως το ιατρικό προσωπικό.

Οι γιατροί που εξετάζουν γυναίκες για καρκίνο του μαστού μπορεί να δουν 5.000 τομογραφίες τον χρόνο ή 100 σε μία βάρδια.

“Υπάρχει το στοιχείο της κούρασης. Ή ακόμα και κάτι που θα σε διακόψει, ομιλίες που θα σε αποσυντονίσουν. Βλέπω τη Mia σαν μια φίλη και μια ενίσχυση της απόδοσής μου στην ιατρική επιστήμη” λέει, στο άρθρο, ο γιατρός Dr Lip.

“Μια μέρα η ΑΙ θα μου επιτρέπει να περνάω περισσότερο χρόνο με τους ασθενείς μου.”

Deepfake με τον Μόργκαν Φρίμαν.

Το black box, η επόμενη επανάσταση και εμείς, οι άνθρωποι

Οι εγκέφαλοι των συστημάτων ΑΙ, ή αλλιώς τα νευρωνικά δίκτυα, μαθαίνουν αποκλειστικά με παραδείγματα. Τροφοδοτούνται με δισεκατομμύρια παραδείγματα βιωμένα από ανθρώπους – τρέφονται δηλαδή από δικές μας γνώσεις και εμπειρίες με αυτό να σημαίνει ότι εγκολπώνονται και ανθρώπινες προκαταλήψεις και μεροληψία.

Όταν τους ζητάμε να λύσουν ένα πρόβλημα, να παράξουν ένα κείμενο ή μία φωτογραφία, ο εγκέφαλός τους συνδυάζει κομμάτια από αυτές τις δισεκατομμύρια πληροφορίες και δημιουργούν αυτόνομα κάτι καινούριο, κάτι δικό τους.

Αυτό για τους επιστήμονες είναι το σημείο-“μαύρο κουτί”: ακόμα και για τον developer που έφτιαξε το πρόγραμμα είναι τελείως άγνωστο και ακατανόητο πώς η μηχανή συνδέει τις πληροφορίες για να δομήσει μία συγκεκριμένη απάντηση.

“Η επόμενη επανάσταση είναι οι μηχανές να μπορούν να δημιουργήσουν μία λύση εκ του μηδενός. Να δημιουργούν κάτι ολόδικό τους όπως πχ τα σχέδια για ένα κτίριο που δεν έχει ξαναφτιαχτεί ποτέ στον κόσμο. Αλλά πρέπει να βρούμε τρόπο αυτό να είναι ερμηνεύσιμο από τον άνθρωπο ώστε να μπορούμε να το εμπιστευτούμε. Το επόμενο μεγάλο ζήτημα, δηλαδή, είναι η ασφάλεια. Αν δεν είναι ερμηνεύσιμο, δεν θα γνωρίζουμε αν είναι ασφαλές” εξηγεί ο Χάρης Γεωργίου.

Ένας από τους μεγάλους φόβους του Χίντον είναι ότι οι μηχανές είναι πολύ πιο έξυπνες από τους ανθρώπους καθώς μέσα τους εμπεριέχεται η γνώση δισεκατομμυρίων ανθρώπινων εγκεφάλων.

Στη συζήτηση στο LSE ο επιστήμονας μοιράστηκε με το κοινό την αγωνία του οι μηχανές να έχουν μελλοντικά ακόμα και δική τους ανεξέλεγκτη βούληση – η συζήτηση άγγιξε δειλά μέχρι και το αν θα έχουν ποτέ τα ρομπότ πολιτικά δικαιώματα.

Δεν είναι καθόλου καινούριο φαινόμενο η τεχνολογία να εγείρει ηθικά ερωτήματα.

Άλλωστε, διαμορφώνει τον τρόπο που ζούμε αλλά και διαμορφώνεται από εμάς. Και δεν είναι κάτι ουδέτερο. Ο έλεγχός της συνεπάγεται κοινωνική και οικονομική εξουσία και γι’ αυτό πρέπει να διεκδικούμε συνεχώς δημοκρατικό έλεγχο επί των καινοτομιών.

Η εποχή της πληροφορίας δεν θα σταματά να μας φέρνει προκλήσεις: ποιες πηγές θα μπορούμε να εμπιστευόμαστε, πώς θα είναι ο παντογνώστης-ίντερνετ όταν θα κατακλύζεται από deep fakes, πόσο θα επηρεάσουν όλα αυτά τον τρόπο που υπάρχουμε, που εργαζόμαστε, που μαθαίνουμε, που επιλέγουμε από το τι θα ψηφίσουμε μέχρι το αν θα ερωτευόμαστε ανθρώπους ή chatbot.

Tα λόγια της Λαμπρινής Γυφτοκώστα αντανακλούν τις σκέψεις αρκετών από εμάς – της τελευταίας γενιάς που θα θυμάται τη ζωή χωρίς τεχνητή νοημοσύνη:

“Υποτίθεται ότι όλα αυτά γίνονται για τους ανθρώπους. Kαμιά φορά νιώθω σαν ψάρι έξω από το νερό. Γίνονται πολύ γρήγορα και δεν ξέρω πώς να τα αφομοιώσω. Δεν ξέρω πώς θα είναι ο κόσμος όταν ο γιος μου θα μεγαλώσει. Τι εκπαίδευση χρειάζεται ένα παιδί για να αντεπεξέλθει; Θα βομβαρδίζεται από deep fakes; Η ΑΙ θα επηρεάζει το τι ψηφίζει και την ελεύθερη βούληση; Θα ζήσουμε καλύτερα χάρη στη βελτίωση της ιατρικής αλλά φοβάμαι να μην χάσουμε τη δύναμη του λόγου και της σκέψης μας με τόσο έτοιμο κείμενο που θα παράγεται. Θα μπορούμε να εκφράζουμε τα συναισθήματά μας πέρα από ένα εμότικον;”

*Η κεντρική φωτογραφία του άρθρου έχει παραχθεί με AI από τον digital artist Jyo John Mulloor. “Τι θα σκεφτόταν ο Αϊνστάιν αν ζούσε σήμερα;”